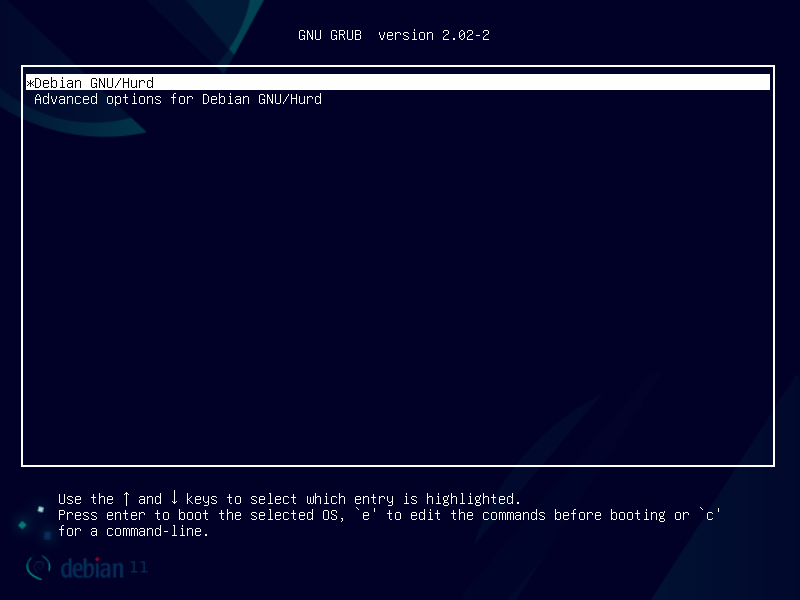

Bootloader 系统引导器

Bootloader之前在做 Alpine 迁移根分区的时候,遇到了引导程序无法正常工作的问题,于是做了各种实验,检查一下各种引导器的对系统的支持情况。 最主流的现代引导器: GRUB systemd-boot rEFInd (refind) 测试使用的操作系统: Alpine Linux Ubuntu GRUB 大多数的 Linux 都默认使用了 GRUB,强大,通用,如果遇到问题,应该都能找到解决办法。 安装grub-install 配置更新引导程序 update-grub systemd-boot systemd-boot 是一个非常简单的引导程序,引导界面没有什么文字,boot选项在屏幕正中间,我个人非常喜欢。 安装# 安装完成之后会自动设置 systemd-boot 为默认引导器,且..

更多

OpenWrt 系列优化 2 雅典娜

OpenWrt 系列优化 2 雅典娜扩容存储刷机的时候是可选root分区大小的,剩下的空间是没有分配的。直接分配挂载就可。 创建分区 fdisk /dev/mmcblk0 n # 值默认都可以 # Command (m for help): n # Partition number (27,28, default 27): # First sector (7741474-241663991, default 7743488): # Last sector, +/-sectors or +/-size{K,M,G,T,P} (7743488-241663991, default 241661951): # Created a new partition 27 of t..

更多

Alpine Linux 存储迁移

Alpine Linux 存储迁移我的两个虚拟机都在一个 500G 的 NVME 硬盘上,由于前期没想到数据备份(snapshot)操作。所以划分的有点太大了,导致现在做数据备份之后剩余存储空间所剩无几,Truenas给出了红色告警。 而且 Alpine Linux 本身就非常节省资源,即使安装了很多应用,根目录也只占用了8G左右,所以 打算把根目录所在的硬盘容量缩减至25G,这也是完全够用的。 如果你问:如果哪天需要临时放一点大文件,没有那么多存储空间怎么办呢。 答案就是:新建虚拟硬盘,挂载到给需要的目录上。这样系统备份不会和数据备份耦合,磁盘空间也不用有那么高的无效占用。数据如果需要备份,再单独创建 snapshot。 本文使用了 GPT-4o 的给出的方案。但在实际的操作过程中,修复了失败的步骤。 ..

更多

OpenWrt 系列优化 1

OpenWrt 系列优化 1Opkg更换源 校园联合网:https://mirrors.cernet.edu.cn/list/openwrt 这里为数不多的可以支持 snapshots 版本的源是南京大学(NJU)的 # src/gz immortalwrt_core https://mirror.nju.edu.cn/openwrt/snapshots/targets/qualcommax/ipq60xx/packages src/gz immortalwrt_base https://mirror.nju.edu.cn/openwrt/snapshots/packages/aarch64_cortex-a53/base src/gz immortalwrt_luci https://mirror.nj..

更多

雅典娜 刷机教程

雅典娜 刷机教程通过 高通 9008 模式刷机,不管是什么版本,机器砖了没有,都可以用该方法刷机,且不需要TTL 1. 前置准备1.1 下载刷机工具包https://github.com/lgs2007m/Actions-OpenWrt/releases/tag/Router-Flashing-Files 1.2 安装高通 USB 驱动包Qualcomm USB Driver v1.0.10061.1.exe 1.3 一些精良的拆机装备 和 拆机因为会用到三种螺丝刀头,所以你需要有足够的装备才可以 1.4 TYPE-A to TYPE-A 的线或 TYPE-C to TYPE-A 的线也可以。 注意不要一直连接,避免 路由器 USB 5v 供电损坏 2. 开始刷机2.1 进入 9008 模式 PC 和 ..

更多

Whiplash 影评

写一点影评再次原谅我到现在才看完了爆裂鼓手,看完了也是非常深有感触 电影所表达的含义是非常深刻的,所以我就拿一些自己的理解去和大家分享一下 暴力鼓手的叙事风格其实挺线性的,但是这个电影唯一有争议的地方其实就是在于结尾,因为结尾是一个开放结尾,所以大家也会有自己各自的想法,那么我就来想表达一下自己的。 本身我就很喜欢音乐和乐器,碰到这个电影真的是相见恨晚了。 电影的前半章都在表达着一种这个老师拔苗助长的风格, 暴力,直接,PUSH到你的LIMIT, 随着剧情推进,主角在进步的过程中,开始把握自己的命运,直到在那个音乐会的过程中发生了事故, 主角和老师双双都坠入低谷, 主角开始了自己的平淡生活,把自己所有乐器相关的东西都抛弃掉,老师呢则退居三线, 在一次 偶然的机会中,两人同台演出,发生了非常有意思的故事情节。..

更多

NAS Gen2 使用报告

写在前面回顾一下,我的第二代 NAS,使用已经刚好两年了,距离最开始的NAS,已经过去四年了。 其实最近才又开始重新折腾,发现之前对软硬件的使用率都太低了. 这带来了生产率和效率问题。 服务和结构对于 NAS 本身来讲,功能单一是最优解,一个特定的功能只解决一件事。但是这无法提高 NAS 上的利用率。附加一些随时可中断的服务,对于现在是更好的选择。 对于我不可接受或最好不要被暂停的服务,我会尽量把它挪到 服务商(Cloudflare, Github)进行托管。 那对于可接受短时间中断的应用,则以应用类型和用途部署到NAS的不同环境上,例如 需要直接访问NAS上的文件,都会尽量通过 NAS 的 Applications(k3s)来提供,部署方式比较复杂或主要提供应用能力的会放在虚拟机上。 所以会有这两种方式来..

更多

IPFS 和 BT 和 PT

探索 本文只做一些初识探索,不介绍具体技术和原理,只是客观场景分析 我自己的看法是,IPFS在未来是有巨大的潜力,只是目前生错了时代,或者说被 加密货币给祸害(?)了。 BT 现在已经可以沦为一种底层技术了。而 PT 则是一个个圈子。 InterPlanetary File System星际文件系统, 这个名字听起来非常浩大,但实际上也确实如此,设计的本意就是能够跨星际共享文件(但其实是有巨大的资源消耗的)。 搭建 IPFS 非常简单,本文不再赘述,只介绍几个概念。 为什么是IPFS,IPFS有哪些不一样 第一点,也是非常重要的一点:去中心化,这样就代表了更高的可靠性(相对),更高的安全性(难以篡改) 如果IPFS仅服务于文件存储,那么它无法进入普通消费者的视线。IPFS另一个特性就是,可以直接提供基于H..

更多

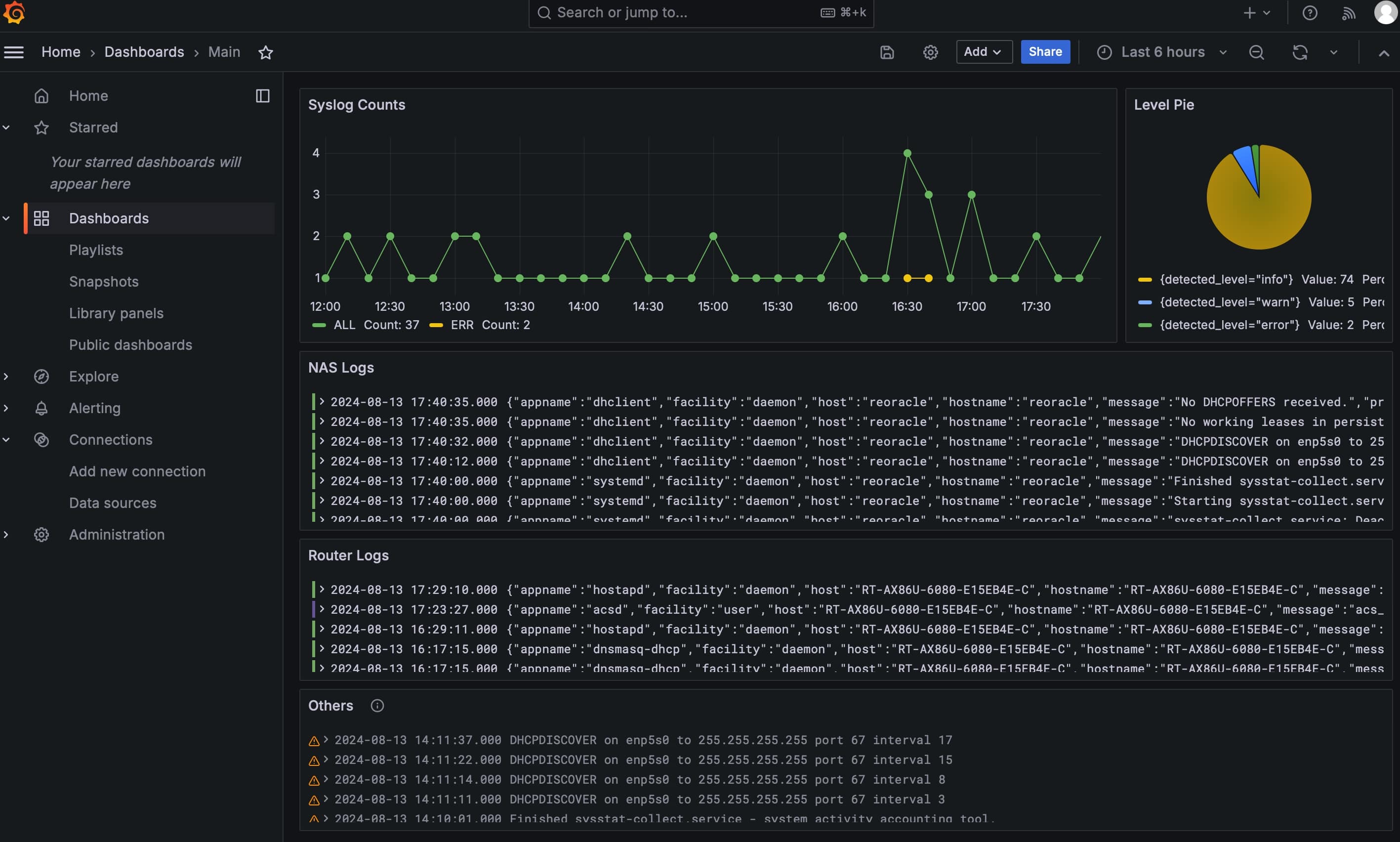

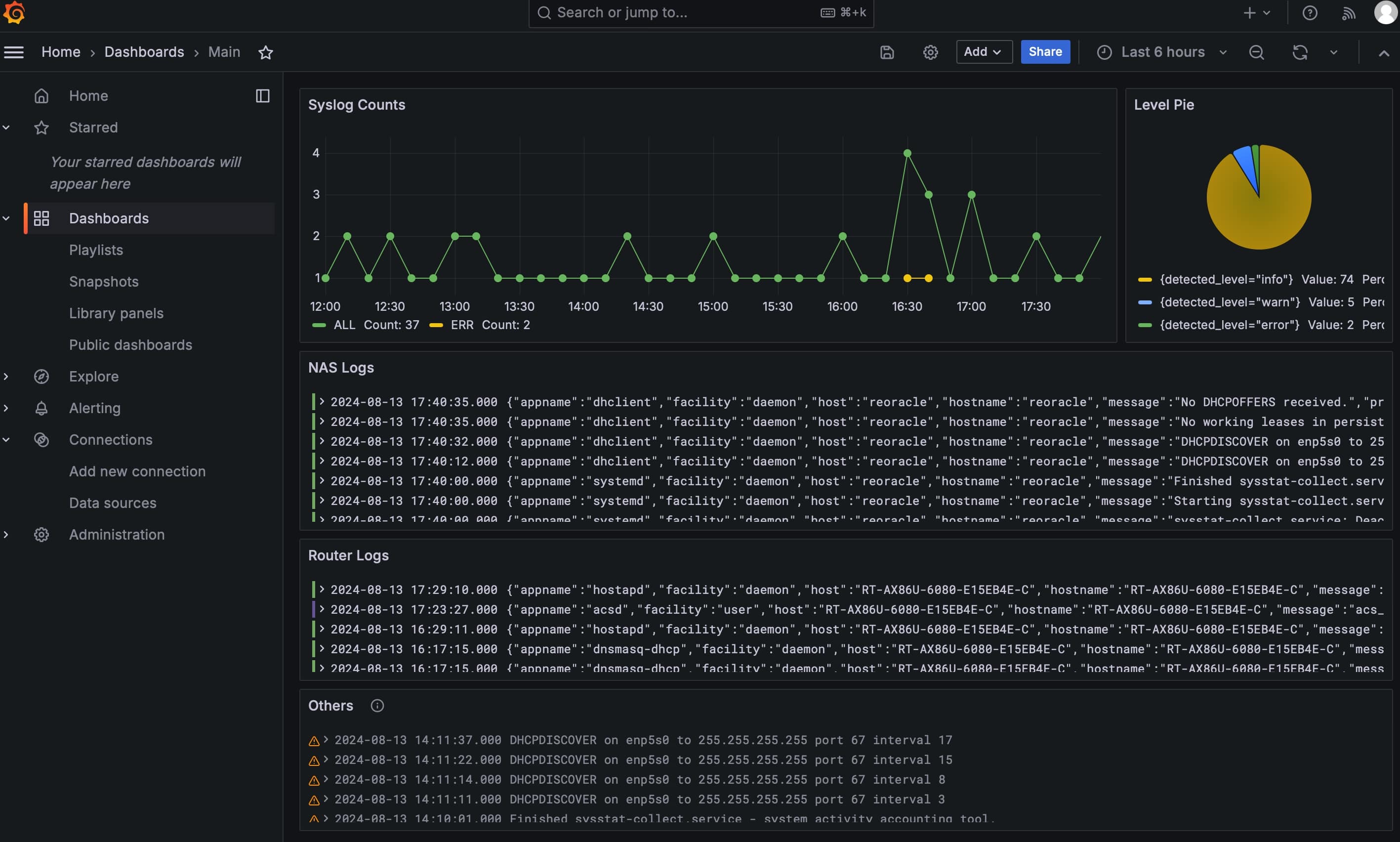

轻量级日志系统

背景还在纠结 Elastic Stack 资源消耗? 还在纠结 Elastic Stack 配置繁杂? 还在纠结 Elastic Stack 维护困难? 今天 我就推出一套我自己的轻量级解决方案: Loki + Vector + Grafana 另外就是再简单说一下,我为什么要搞这么个轻量级日志系统,我的 NAS 和 路由器的日志都可以发送到syslog上,NAS上有很多时候会报一些奇奇怪怪的错,如果是硬盘发生了问题就更恐怖了。 所以我想把日志都收集起来,做统一的分析和告警。但是呢 日志收集并不能在我本地的NAS上做,如果NAS的虚拟机崩了,或重启了,有部分日志会丢失,所以,我选择在我的朋友的机器上做收集,然后我远程发送过去。 日志三大件LokiLoki 是列式数据库新起之秀,类似于 Prometheus,..

更多

搭建一个简单的私有 BT Tracker 服务

Idea本来的一个想法是 用国内网盘的离线下载能力,把我本地的文件上传到网盘上,可以很优雅的做备份。 正常流程 我们做备份,一般都是 push,也就是上传文件到网盘上,这种方式 则是网盘去主动 pull 你的数据,想想是不是还挺好玩。 serverserver的选择不多,Github 上看下来,比较简单的项目有两个: https://github.com/webtorrent/bittorrent-tracker https://github.com/naim94a/udpt bittorrent-tracker这里我选择 这个基于Node构建的服务,简单高效,还有个小的状态页面 安装npm install -g bittorrent-tracker 运行# 这里只使用了 udp 协议 bittorr..

更多